🧭 À lire, réfléchir, partager.

Note : Mes billets réflexifs continuent. Ceci n’est pas un éditorial, mais un résumé des nouvelles des 7 derniers jours. Une revue hebdomadaire des points saillants en lien avec l’IA de sens ou qui n’en a pas! Une revue de l’actualité avec une dimension qui ajoute du sens aux impacts de l’IA dans nos vies. J’y ai ai ajouté des éléments d’analyse structurante et les impacts Canada/Québec lorsque pertinent. La vidéo est un résumé qui se veut plus ludique et sommaire pour les pressés. 6 minutes pour rester à jour sur mon temps. ;)

Gouvernance, éthique et transformations sociétales de l’intelligence artificielle

Introduction — radar de la semaine

Une tendance déjà visible depuis plusieurs semaines se confirme : l’IA quitte progressivement le simple terrain de la performance technique pour devenir une question d’infrastructures, de souveraineté et de pouvoir économique.

Encore cette semaine, les annonces les plus importantes concernent moins les capacités des modèles eux-mêmes que les rapports de force autour de leur contrôle. L’Union européenne assouplit certaines règles de son AI Act, les États-Unis obtiennent un accès anticipé à des modèles avancés pour des tests de sécurité nationale, et le Canada constate officiellement que la gouvernance ne suit pas la vitesse d’adoption de l’IA.

La nouveauté n’est donc plus seulement technologique. Elle est institutionnelle. Les vrais enjeux deviennent : qui teste les modèles, qui définit les risques acceptables, qui contrôle les infrastructures de calcul, et qui porte les conséquences quand les systèmes échouent.

Ce qui a du sens

1) Tester les modèles avant leur déploiement massif

Les États-Unis ont obtenu de Google, Microsoft et xAI un accès anticipé à certains modèles d’IA afin de réaliser des tests liés à la sécurité nationale. Selon Reuters, les évaluations portent notamment sur des usages potentiels en cybersécurité, en manipulation biologique ou dans la désinformation. L’objectif est d’identifier des risques avant la mise en circulation plus large des modèles.

C’est un signal important. Depuis plusieurs mois, les gouvernements réagissent surtout après les incidents. Ici, on voit apparaître une logique plus préventive. Ce n’est pas encore une gouvernance démocratique complète, mais c’est un déplacement du contrôle vers l’amont.

Le vrai enjeu devient toutefois la transparence. Qui voit les résultats? Quels critères sont utilisés? Quels modèles seraient jugés trop risqués? Pour l’instant, ces réponses demeurent largement fermées au public.

Lecture IA de sens

Ce n’est pas seulement une mesure technique. C’est une tentative de déplacer le pouvoir d’évaluation avant le marché.

Qui décide : les agences gouvernementales et les grandes entreprises IA.

Qui gagne : les institutions ayant accès aux modèles avant le public.

Qui perd : les citoyens si les critères demeurent opaques.

Le Canada devra choisir s’il développe sa propre capacité indépendante d’évaluation des modèles avancés ou s’il dépend des standards américains. Le risque stratégique est important : importer des doctrines de sécurité sans véritable débat public canadien.

Liens utiles

Reuters — Microsoft, Google et xAI partageront des modèles avec le gouvernement américain

NIST — AI Risk Management Framework

2) Le Canada reconnaît enfin que la gouvernance IA est en retard

Une étude publiée le 7 mai par IBM Canada indique que 63 % des dirigeants canadiens estiment que les lacunes de gouvernance ralentissent déjà le déploiement de l’IA à grande échelle. Plus marquant encore : les irrégularités liées à l’IA coûteraient environ 144 millions de dollars par année aux grandes entreprises canadiennes.

Le plus intéressant dans cette étude n’est pas le montant. C’est la cause. Une grande partie des pertes viendrait de problèmes organisationnels : manque de supervision, duplication des systèmes, mauvaise qualité des données et absence de responsabilité claire.

Depuis plusieurs semaines, on observe la même dynamique : les entreprises investissent massivement dans les outils, mais beaucoup moins dans les mécanismes de contrôle. Cette semaine, le Canada commence officiellement à nommer ce problème.

Lecture IA de sens

Ce n’est pas seulement un problème technologique. C’est un problème de gouvernance et de souveraineté numérique.

Qui décide : les directions et les fournisseurs technologiques.

Qui gagne : les organisations capables d’encadrer leurs systèmes.

Qui perd : celles qui automatisent sans structure de supervision.

Le choix stratégique implicite devient clair : investir dans la gouvernance peut sembler moins spectaculaire que lancer de nouveaux projets IA, mais c’est probablement ce qui déterminera la confiance et la résilience des organisations canadiennes dans les prochaines années.

Liens utiles

IBM Canada — Étude sur la gouvernance IA

Gouvernement du Canada — Utilisation responsable de l’IA

3) Google améliore les réponses IA vérifiables grâce au RAG

Google a annoncé l’expansion de Gemini API File Search, un outil permettant à l’IA de retrouver de l’information dans différents types de documents et de montrer plus précisément les sources utilisées.

Cette approche repose sur le RAG, pour Retrieval-Augmented Generation : une méthode où l’IA va chercher des informations dans des documents précis avant de répondre, plutôt que de produire une réponse uniquement à partir de son entraînement statistique.

En pratique, cela peut rendre certaines réponses plus fiables et plus auditables. Pour les secteurs comme la santé, l’éducation, les services publics ou le droit, cette capacité devient essentielle : une réponse IA doit pouvoir être reliée à une source identifiable.

La tendance se poursuit donc : après la course à la puissance des modèles, l’industrie commence enfin à se concentrer davantage sur la vérifiabilité.

Lecture IA de sens

Ce n’est pas seulement une amélioration technique. C’est une tentative de rendre les systèmes IA plus explicables.

Qui décide : les entreprises qui conçoivent les architectures IA.

Qui gagne : les utilisateurs pouvant vérifier les réponses.

Qui perd : les systèmes opaques incapables de justifier leurs résultats.

Pour le Canada bilingue et le Québec francophone, un enjeu important sera la qualité des sources francophones utilisées par ces systèmes. Une IA qui cite surtout des contenus anglophones peut rapidement créer un déséquilibre informationnel.

Liens utiles

Google AI — Gemini API File Search

Google Developers Blog

Ce qui soulève des questions

1) L’Europe ralentit certaines protections de l’AI Act

L’Union européenne a conclu cette semaine une entente provisoire qui reporte certaines obligations liées aux systèmes d’IA à haut risque, notamment en biométrie et en infrastructures critiques.

Le report irait jusqu’en décembre 2027 pour certaines dispositions. L’objectif affiché est de réduire la pression réglementaire sur l’industrie européenne afin de préserver la compétitivité.

Mais cette décision révèle une tension de plus en plus visible depuis plusieurs mois : même les juridictions les plus ambitieuses commencent à assouplir leurs règles face à la pression économique et géopolitique.

Le risque est important. Les systèmes avancés continuent d’être déployés pendant que les mécanismes de contrôle sont retardés.

Lecture IA de sens

Ce n’est pas seulement un ajustement réglementaire. C’est un arbitrage politique entre protection et compétitivité.

Qui décide : les institutions européennes sous pression industrielle.

Qui gagne : les grands acteurs capables d’attendre les règles définitives.

Qui perd : les citoyens exposés à des systèmes encore mal encadrés.

Le Canada pourrait être tenté de ralentir lui aussi ses propres mécanismes d’encadrement. Ce serait risqué : moins de réglementation ne signifie pas moins de risques.

Liens utiles

Reuters — AI Act européen assoupli

Parlement européen — AI Act

2) La sécurité nationale devient le principal langage de l’IA

Encore cette semaine, l’IA est de plus en plus traitée comme une infrastructure stratégique comparable à l’énergie, aux télécommunications ou à la cybersécurité.

Les tests américains sur les modèles avancés montrent que les gouvernements craignent désormais des usages liés aux cyberattaques, à la désinformation massive ou à des risques biologiques.

Cette évolution est compréhensible. Mais elle soulève une tension importante : si la sécurité nationale devient le principal cadre de gouvernance, les droits civiques, la transparence et l’intérêt public risquent de devenir secondaires.

La tendance se poursuit donc : l’IA quitte progressivement le domaine purement commercial pour entrer dans celui des doctrines de puissance.

Lecture IA de sens

Ce n’est pas seulement une question de sécurité. C’est une question de pouvoir institutionnel.

Qui décide : les agences de sécurité et les grandes plateformes technologiques.

Qui gagne : les acteurs ayant accès aux infrastructures critiques.

Qui perd : le public si les décisions restent opaques.

Le Canada devra clarifier ses propres lignes rouges concernant l’IA militaire, la cybersécurité et la surveillance algorithmique, plutôt que simplement suivre les orientations américaines.

Liens utiles

Reuters — Security reviews of frontier AI models

NIST AI Risk Management Framework

Ce qui n’a pas de sens

1) Déployer des systèmes à haut risque avant les protections

Reporter certaines obligations réglementaires pendant que les usages sensibles continuent de croître crée un déséquilibre dangereux. Les citoyens doivent vivre avec des systèmes biométriques, décisionnels ou de surveillance avant même que les règles soient pleinement en place.

Depuis plusieurs mois, on voit la même dynamique : la vitesse de déploiement devient plus importante que la capacité collective de comprendre les conséquences.

Ce n’est pas une gouvernance stable. C’est une gouvernance en rattrapage permanent.

Lecture IA de sens

Ce n’est pas seulement un retard administratif. C’est un transfert des risques vers la population.

Qui gagne : les acteurs capables de déployer rapidement.

Qui perd : les personnes affectées par des systèmes difficiles à contester.

Le Canada et le Québec devront éviter le piège consistant à attendre que les crises surviennent avant de clarifier les mécanismes de responsabilité.

Liens utiles

Reuters — AI Act européen

2) Confondre tests secrets et confiance publique

Les tests de sécurité sur les modèles avancés peuvent être utiles. Mais si les évaluations restent entièrement fermées, le public ne saura jamais quels risques sont réellement mesurés, quels modèles échouent, ni quelles corrections sont imposées.

Une IA évaluée en secret n’est pas automatiquement une IA responsable.

Le vrai enjeu n’est donc pas seulement de tester les systèmes. C’est de rendre les critères compréhensibles et contestables.

Lecture IA de sens

Le contrôle ne peut pas simplement passer du marché vers l’État sans mécanismes démocratiques intermédiaires.

Une décision importante à surveiller : le Canada créera-t-il une capacité indépendante d’audit des modèles avancés?

Liens utiles

NIST — AI Risk Management Framework

À surveiller

Matrice prospective

| Signal | Trajectoire | Enjeu | Horizon |

|---|---|---|---|

| AI Act européen assoupli | Règles plus lentes | Protection vs compétitivité | Court terme |

| Tests gouvernementaux des modèles | Évaluation en amont | Transparence des critères | Court terme |

| Gouvernance IA canadienne | Reconnaissance du retard | Responsabilité organisationnelle | Court terme |

| RAG vérifiable | Réponses reliées à des sources | Auditabilité des systèmes | Moyen terme |

| Sécurité nationale | IA traitée comme infrastructure critique | Souveraineté et droits | Moyen terme |

Cette semaine ne marque pas une rupture complète, mais une consolidation. La tendance observée depuis plusieurs éditions se poursuit : l’IA devient progressivement un système de pouvoir partagé entre entreprises technologiques, infrastructures cloud, États et organismes de régulation.

Lecture stratégique de la semaine

Matrice de maturité éthique

| Niveau | Signal | Situation | Risque |

|---|---|---|---|

| Constructif | RAG avec sources | Meilleure vérifiabilité | Modéré |

| En transition | Tests anticipés des modèles | Contrôle plus préventif | Élevé |

| Zone grise | Gouvernance canadienne insuffisante | Adoption plus rapide que supervision | Élevé |

| Tension forte | AI Act reporté | Protection retardée | Systémique |

| Critique | Sécurité nationale | Gouvernance opaque | Démocratique |

Les capacités techniques progressent rapidement, mais les mécanismes démocratiques de supervision restent inégaux et souvent incomplets.

Message clé de la semaine

La tendance se poursuit : l’IA ne se joue plus seulement dans les modèles eux-mêmes, mais dans les règles, les infrastructures, les mécanismes de sécurité et la capacité des organisations à rendre des comptes.

Conclusion stratégique

L’édition du 7 mai montre une consolidation des dynamiques observées depuis plusieurs semaines. Les grands thèmes reviennent — gouvernance, souveraineté, sécurité, infrastructures — mais ils deviennent plus concrets et plus institutionnels.

La tension majeure est claire : les capacités techniques sont intégrées plus vite que les mécanismes démocratiques capables de les superviser. Ce n’est pas seulement un retard réglementaire. C’est un déplacement du pouvoir.

Pour une IA de sens, la question devient donc très concrète : voulons-nous seulement des systèmes plus puissants, ou des systèmes dont les limites sont réellement définies, expliquées et contestables?

L’évolution s’accélère jour après jour avec l’IA et ses impacts. Pendant ce temps, la conscience humaine et l’ordre nécessaire pour y faire face s’érodent encore plus vite.

Savoir c’est pouvoir…. Pouvoir c’est aussi agir! Si tu as besoin de comprendre, n’hésite pas! Je peux approfondir des sujets qui te turlupine. Aussi, SVP partage. Il faut que la population développe son esprit critique afin de participer à la conversation publique. Il y a aussi la question qui s’ajoute chaque jour : si mon compétiteur utilise l’IA vais-je prendre du recul pour ma propre entreprise? Si cette question résonne, fais-moi signe!

La Brigade IA est en action. Je suis assignée sur le chamtier « Base culturelle et sécuritaire » dans un groupe très dynamique pour établir les guides de politique interne pour l’utilisation de l’IA. Si tu veux comprendre la Brigade IA en une image clique ici.. Les travaux ont débuté en grand. Une politique interne d’usage de l’IA est fondamental dans la volonté de faire de l’IA de sens.

Bonne journée!

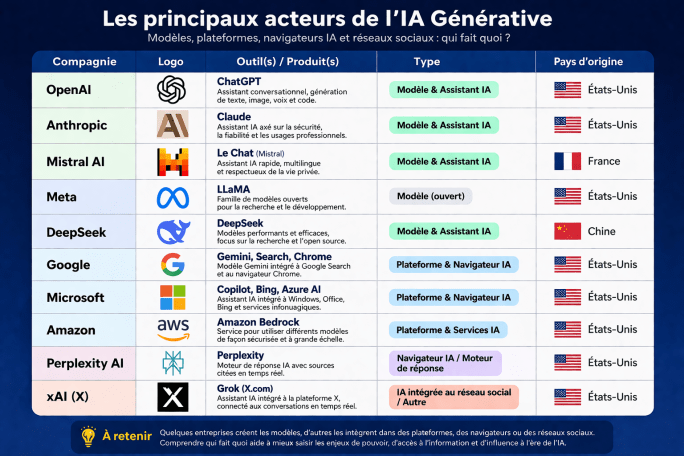

PERDU AVEC TOUS LES OUTILS D’IA GÉNÉRATIVE?

VOICI UN TABLEAU POUR COMPRENDRE LES DIFFÉRENTS ACTEURS

Si le sujet t’intéresse, voici des articles dans la catégorie « IA de sens ».

La revanche des nerds ou la souveraineté cognitive?

Et si la vraie bataille de l’ère numérique ne se jouait pas sur les territoires… mais dans nos têtes?

À travers une réflexion personnelle et sans compromis, ce billet explore la montée en puissance des « nerds », devenus architectes d’un monde façonné par l’intelligence artificielle. Mais derrière cette revanche technologique se cache un enjeu…

La dette cognitive et la nouvelle économie du discernement

Ce qui m’interpelle dorénavant, ce sont les études qui se succèdent pour documenter les effets de l’utilisation de l’IAG dans le quotidien de la population. Je te préviens, ce n’est pas inquiétant, c’est alarmant. Nous parlons de « dette cognitive » rien de moins. L’humain a déjà assez de s’endetter financièrement, il s’endette dorénavant dans ses capacités…

Lire le monde tel qu’il est devenu

Nous vivons au cœur d’un système devenu trop vaste pour être saisi d’un seul regard : un hyperobjet technocapitaliste qui concentre pouvoir, richesse, données et énergie, tout en échappant au débat collectif. Pendant que l’attention se perd dans le vacarme émotionnel, les décisions qui engagent des générations se prennent presque en silence. Ce texte propose…

La fin du monde est à quelle heure?

La fin du monde n’a pas d’heure précise. Mais la fin d’un monde est déjà en cours. Entre intelligence artificielle, crise climatique et démocratie fragilisée, nous sommes à une croisée des chemins historique. Ce texte n’est ni technophobe ni naïf : il interroge la course à l’IA, la concentration du pouvoir, l’illusion du progrès inévitable…

En savoir plus sur Sylvie Bédard - Complice de votre Présence

Abonnez-vous pour recevoir les derniers articles par e-mail.