🧭 À lire, réfléchir, partager.

Note : Mes billets réflexifs continuent. Ceci n’est pas un éditorial, mais un résumé des nouvelles des 7 derniers jours. Une revue hebdomadaire des points saillants en lien avec l’IA de sens ou qui n’en a pas! Une revue de l’actualité avec une dimension qui ajoute du sens aux impacts de l’IA dans nos vies. J’y ai ai ajouté des éléments d’analyse structurante et les impacts Canada/Québec lorsque pertinent. La vidéo est un résumé qui se veut plus ludique et sommaire pour les pressés. 6 minutes pour rester à jour sur mon temps. ;)

Gouvernance, éthique et transformations sociétales de l’intelligence artificielle

Introduction — radar de la semaine

Cette semaine confirme un basculement important : l’intelligence artificielle ne progresse plus seulement en capacité, elle s’insère désormais dans des domaines critiques où ses décisions peuvent avoir des effets réels sur la cybersécurité, les finances personnelles et l’organisation du travail.

Quatre signaux dominent. OpenAI étend son programme d’accès contrôlé en cybersécurité avec GPT-5.4-Cyber; Anthropic avance dans les architectures multi-agents coordonnées; le Stanford AI Index 2026 documente une hausse de la méfiance sociale envers l’IA; et Perplexity se déplace vers la finance personnelle via l’intégration de données bancaires.

La tension principale est désormais claire : ce n’est plus seulement ce que l’IA peut faire qui compte, mais qui contrôle ses usages, qui définit les accès légitimes et qui absorbe les risques quand ces systèmes entrent dans des secteurs sensibles.

Ce qui a du sens

1) Accès contrôlé à l’IA en cybersécurité : une gouvernance par usage émerge

OpenAI a annoncé le 14 avril l’extension de son programme Trusted Access for Cyber. L’entreprise explique qu’elle élargit désormais l’accès à des milliers de défenseurs vérifiés et à des centaines d’équipes responsables de logiciels critiques, tout en ajoutant GPT-5.4-Cyber, une version plus permissive pour les usages défensifs en cybersécurité. L’accès repose sur des mécanismes de vérification d’identité et sur des niveaux d’accès gradués, notamment pour les chercheurs et fournisseurs de sécurité jugés légitimes. Ce signal a du sens parce qu’il reconnaît qu’une même capacité d’IA ne devrait pas circuler sans distinction dans tous les contextes. On voit apparaître ici une logique de gouvernance par usage, et non seulement par niveau de performance.

Pour le Canada, notamment dans la protection des infrastructures critiques et des services publics, ce type de modèle pose une question stratégique : faut-il adopter les régimes d’accès définis par les grands acteurs privés, ou bâtir des mécanismes publics d’habilitation à l’IA critique? Pour le Québec, cela touche aussi la capacité des institutions à sécuriser l’usage de l’IA sans dépendre entièrement de standards importés.

Liens utiles

OpenAI — Trusted access for the next era of cyber defense

2) Coordination d’agents IA : vers des systèmes organisés et plus gouvernables

Anthropic a détaillé cette semaine sa lecture des architectures agentiques dans un billet d’ingénierie sur les systèmes multi-étapes pilotés par des modèles. L’entreprise distingue les workflows, où les étapes sont prédéfinies dans du code, des agents, où les modèles dirigent eux-mêmes leurs processus et usages d’outils. Elle note aussi que ces agents émergent maintenant en production à mesure que les modèles deviennent meilleurs pour planifier, utiliser des outils et récupérer après des erreurs. Ce changement est important parce qu’il transforme l’IA en système structuré plutôt qu’en simple assistant unique. Cela ne supprime pas les risques, mais cela va dans le sens d’une IA plus auditée et plus intelligible dans des usages complexes.

Dans les administrations et grandes organisations canadiennes, cette évolution pourrait faciliter l’adoption de systèmes IA plus traçables. Mais elle oblige aussi à définir des règles précises sur la délégation, la supervision humaine et la responsabilité en cascade lorsque plusieurs agents interviennent dans une même chaîne de décision. Pour le Québec, l’enjeu rejoint directement les exigences croissantes en matière de reddition de comptes et de protection des données.

Liens utiles

Anthropic — Building Effective AI Agents

3) La défiance sociale envers l’IA devient un fait politique concret

Le Stanford AI Index 2026 documente une progression de la méfiance et des tensions entourant l’intelligence artificielle dans plusieurs régions du monde. Cette tendance ne reste plus abstraite. Le 13 avril, Reuters a rapporté qu’un homme du Texas a été inculpé après avoir lancé un cocktail Molotov contre la résidence de Sam Altman et tenté de mettre le feu au siège d’OpenAI. L’incident n’a pas fait de blessés, mais il montre que l’IA n’est plus seulement un sujet technique ou économique : elle devient un objet de colère politique et sociale. Quand les citoyens ont le sentiment que les décisions technologiques avancent plus vite que les mécanismes de contrôle collectif, la contestation peut se radicaliser.

Le Canada pourrait être tenté de se croire à l’abri de telles tensions. Ce serait une erreur. Sans espaces de délibération publique, sans pédagogie et sans mécanismes visibles de gouvernance, la méfiance peut s’installer brutalement. Pour le Québec, cela renforce l’importance de traiter l’IA comme un enjeu démocratique et non seulement économique ou industriel.

Liens utiles

Stanford HAI — AI Index Report

Reuters — Man charged after Molotov cocktail attack on Sam Altman’s home

4) L’IA entre dans la finance personnelle : un déplacement vers l’irréversible

Perplexity pousse maintenant plus loin sa présence dans les usages financiers avec des pages dédiées à la finance, aux listes d’actions et aux portefeuilles, où l’entreprise promet de pouvoir répondre à des questions sur les dépenses, les prêts et d’autres sujets financiers personnels. Même si les fonctions exactes évoluent encore, le mouvement est clair : l’IA ne se limite plus à la recherche généraliste, elle s’approche de l’assistance financière personnalisée. Ce changement est majeur parce qu’il place l’IA dans un domaine où les erreurs n’ont pas seulement des conséquences informationnelles, mais des effets concrets sur les décisions économiques des personnes. Le signal a du sens parce qu’il rend visible le déplacement de l’IA vers des secteurs où la confiance, la sécurité et la responsabilité deviennent non négociables.

Pour les autorités canadiennes et québécoises, l’enjeu est immédiat : responsabilité en cas de recommandation erronée, auditabilité des systèmes, protection des données bancaires et clarté sur la frontière entre assistance et conseil automatisé. Ce type d’outil pourrait progresser vite avant même que les garde-fous réglementaires soient pleinement définis.

Liens utiles

Perplexity Finance

Perplexity Finance — Portfolio

Ce qui soulève des questions

1) OpenAI contre Anthropic : le débat sur l’accès masque encore les vrais mécanismes de contrôle

OpenAI défend une logique d’accès contrôlé plus large pour certains usages sensibles, avec vérification d’identité, niveaux d’accès et déploiement progressif. Anthropic, de son côté, met davantage l’accent sur la limitation de certaines capacités jugées trop risquées et sur des garde-fous plus restrictifs. À première vue, le débat semble opposer ouverture et prudence. Mais la vraie question n’est pas seulement combien d’acteurs obtiennent l’accès. Elle est de savoir qui sélectionne les organisations admises, sur quels critères, avec quelle transparence, et avec quelles capacités réelles de vérification après déploiement. Sans réponses claires, le contrôle peut rester plus affirmé que démontré.

Le Canada devra éviter de reprendre passivement ces modèles de gouvernance privée. Dans des domaines sensibles comme la cybersécurité, la santé ou la finance, la question n’est pas seulement d’avoir accès aux bons outils, mais de savoir selon quelles règles publiques ces accès sont jugés légitimes et comment les abus sont réellement encadrés.

Liens utiles

OpenAI — Trusted access for the next era of cyber defense

Anthropic — Responsible Scaling Policy

2) Une IA qui gère un magasin réel : la responsabilité reste plus floue que l’autonomie promise

Des expérimentations relayées cette semaine autour d’un magasin piloté par IA montrent un glissement important : l’IA ne se contente plus d’aider un humain à décider, elle commence à agir dans un environnement matériel avec des conséquences sur les clients, les stocks, les prix et le fonctionnement quotidien. On franchit donc un seuil. Les erreurs ou mauvaises décisions ne se limitent plus à une réponse incorrecte à l’écran, elles deviennent des actes avec effets réels. Or le cadre de responsabilité, lui, reste encore largement incertain. Qui répond si l’agent se trompe, discrimine, gaspille ou déstabilise le travail humain autour de lui?

Pour les entreprises canadiennes et québécoises, ce type d’expérimentation annonce des pressions accrues vers l’automatisation de fonctions de gestion. Mais avant de généraliser ce modèle, il faudra clarifier la responsabilité légale, la supervision minimale requise et les conséquences sur l’emploi, en particulier dans les secteurs déjà fragilisés par les transformations technologiques.

Liens utiles

MIT Technology Review

3) Ne pas publier certains modèles à risque : prudence utile, gouvernance globale absente

Anthropic explique pourquoi certaines capacités jugées trop dangereuses ne sont pas diffusées largement, notamment lorsqu’elles pourraient faciliter des usages catastrophiques ou des abus graves. Ce choix peut paraître responsable, et il l’est en partie. Mais il révèle aussi une réalité plus dérangeante : ce sont encore des entreprises privées qui décident, en pratique, où se situe la frontière entre diffusion acceptable et risque collectif trop élevé. Cette logique de retenue volontaire ne remplace pas une doctrine partagée et démocratiquement débattue sur les capacités sensibles. Autrement dit, la prudence privée ne suffit pas à faire une gouvernance publique.

Le Canada et le Québec devront tôt ou tard clarifier comment ils souhaitent gouverner la diffusion des capacités d’IA les plus sensibles. Sans cadre clair, la décision sur ce qui est “trop risqué” sera laissée aux laboratoires eux-mêmes, avec des conséquences directes sur la souveraineté technologique et la sécurité publique.

Liens utiles

Anthropic — Responsible Scaling Policy

Ce qui n’a pas de sens

1) Présenter l’AEO comme une simple suite logique du SEO

Plusieurs discours marketing présentent encore l’Answer Engine Optimization comme une simple évolution naturelle du référencement classique. Cela n’a pas de sens. Le changement en cours n’est pas seulement technique. Il touche la manière dont l’information est sélectionnée, reformulée et hiérarchisée par des systèmes d’IA qui répondent à la place du moteur traditionnel. Réduire cette mutation à une nouvelle couche tactique de visibilité masque une transformation beaucoup plus profonde du pouvoir de médiation informationnelle.

Pour les médias, les institutions publiques et les organisations québécoises qui dépendent de leur découvrabilité en ligne, cette confusion peut conduire à de mauvaises décisions stratégiques. Le vrai enjeu est de comprendre comment préserver l’accès à une information fiable et visible dans des environnements où les interfaces IA filtrent de plus en plus les réponses.

Liens utiles

Search Engine Land — Answer Engine Optimization

2) Déployer des fonctions IA intégrées sans pédagogie suffisante sur les risques

Les nouvelles fonctions IA intégrées à des outils de grande diffusion sont souvent présentées sous l’angle du confort, de la rapidité et de la fluidité. Ce cadrage laisse trop souvent dans l’ombre les risques très concrets : injections de prompt, accès implicites aux données, confusion sur ce qui est envoyé au modèle et sur ce qui reste local. Le problème n’est donc pas seulement sécuritaire. C’est un déficit de clarté publique sur les conditions réelles d’usage.

Dans les milieux publics, éducatifs et professionnels, cette absence de pédagogie augmente le risque d’usage naïf d’outils puissants. Pour le Canada comme pour le Québec, le défi n’est pas seulement d’adopter l’IA, mais de faire monter la littératie numérique et la compréhension des risques à la même vitesse que les déploiements.

Liens utiles

Google Chrome Blog

3) Continuer la surpromesse autour de produits IA encore peu éprouvés

Plusieurs lancements ou démonstrations continuent d’être présentés dans un registre de rupture quasi inévitable, alors même que leurs usages réels, leurs limites et leurs impacts sociaux restent peu documentés. Cette logique de surpromesse n’a pas de sens parce qu’elle nourrit un cycle prévisible : emballement médiatique, attente disproportionnée, déception, puis perte de confiance. Une communication responsable devrait expliquer non seulement ce que fait l’outil, mais aussi ce qu’il ne fait pas encore, ce qu’il déplace et ce qu’il risque de fragiliser.

Dans un contexte où les gouvernements, les entreprises et les établissements d’enseignement doivent prendre des décisions rapides sur l’IA, la surpromesse complique la priorisation. Elle peut détourner l’attention des usages réellement utiles et rendre plus difficile un débat public lucide sur les bénéfices, les coûts et les conditions d’adoption acceptables.

Liens utiles

The Verge — AI coverage

À surveiller

Matrice prospective

| Signal | Trajectoire | Enjeu | Horizon |

|---|---|---|---|

| Accès différencié aux capacités d’IA | Standardisation de régimes d’accès par usage et par profil | Qui définit les accès légitimes? | Court terme |

| Agents autonomes dans les opérations réelles | Déploiement graduel dans la gestion, le service et les flux de travail | Responsabilité, supervision, emploi | Court à moyen terme |

| IA financière branchée aux données sensibles | Croissance rapide des usages d’assistance et de recommandation | Risque systémique et protection des données | Court terme |

| Défiance sociale envers l’IA | Politisation accrue des débats et hausse des réactions de rejet | Légitimité démocratique de l’adoption | Moyen terme |

Lecture rapide : les signaux de la semaine convergent vers une même trajectoire. L’IA ne se contente plus d’améliorer des tâches ponctuelles; elle se rapproche d’un rôle d’infrastructure de décision. À mesure qu’elle entre dans des secteurs plus sensibles, la question centrale devient moins la performance que les conditions d’accès, les mécanismes de contrôle et la capacité des institutions à imposer des limites crédibles.

Lecture stratégique de la semaine

Matrice de maturité éthique

| Niveau | Signal | Situation | Risque |

|---|---|---|---|

| Émergent | Accès contrôlé en cybersécurité | Usages plus ciblés avec gouvernance encore en construction | Risque modéré |

| Zone grise | Systèmes multi-agents et magasin géré par IA | Autonomie croissante, responsabilité encore diffuse | Risque élevé |

| Tension forte | Défiance sociale et radicalisation du débat | Écart croissant entre vitesse du déploiement et légitimité perçue | Risque très élevé |

| Dérive potentielle | IA branchée aux finances personnelles | Données sensibles et décisions à conséquences directes | Risque systémique |

Cette semaine, la maturité technique progresse plus vite que la maturité institutionnelle. Les capacités avancent; les doctrines publiques pour encadrer leurs usages restent fragmentées.

Carte des tensions de gouvernance

| Axe | Pôle 1 | Pôle 2 | Signal |

|---|---|---|---|

| Accès | Ouverture ciblée | Restriction prudente | OpenAI vs Anthropic |

| Organisation du travail | Automatisation et coordination | Supervision et responsabilité | Agents IA, magasin géré par IA |

| Données sensibles | Assistance personnalisée | Protection et auditabilité | Perplexity et finance personnelle |

| Légitimité sociale | Innovation accélérée | Acceptabilité démocratique | AI Index, incident Sam Altman |

Interprétation : la semaine montre un déplacement du centre de gravité de l’IA. Elle n’est plus seulement vendue comme un outil d’assistance; elle commence à devenir une infrastructure de sélection, de décision et d’accès. Or, quand cette infrastructure est majoritairement définie par des acteurs privés, la question démocratique devient inévitable.

Boussole stratégique IA de sens

| Dimension | Question | Lecture |

|---|---|---|

| Technologie | Est-ce réellement utile? | Oui, lorsque les capacités servent des usages ciblés et vérifiables plutôt qu’une simple logique d’expansion |

| Gouvernance | Qui fixe les limites? | Encore largement les entreprises qui contrôlent les modèles, les accès et les usages autorisés |

| Économie | Qui capte la valeur? | Les plateformes et les détenteurs d’infrastructure conservent un avantage structurel |

| Société | Qui absorbe les coûts? | Souvent les citoyens, les travailleurs et les personnes dont les données ou les choix deviennent dépendants des systèmes |

| Humanité | Est-ce au service des droits? | Partiellement seulement, tant que les règles d’accès, de recours et de responsabilité restent peu explicites |

Outils utiles

| Outil | Contexte | Fonction | Utilité |

|---|---|---|---|

| VIKTOR | Déploiement d’apps, workflows et agents en ingénierie | Automatiser des workflows avec IA et partager les applications de façon sécurisée | Intéressant pour les équipes qui veulent expérimenter des agents et automatisations sans perdre la traçabilité ni les contrôles de sécurité |

| Algolia — Building agentic AI | Recherche, récupération et agents | Livre blanc sur les agents IA, le MCP et la connexion sécurisée aux outils et sources de données | Utile pour comprendre comment bâtir des agents qui ne se contentent pas de répondre, mais exécutent des actions reliées à des systèmes réels |

| Claude Enterprise | Usage organisationnel | Accès aux plans équipe et entreprise, avec offres orientées déploiement en organisation | Pertinent pour les organisations qui cherchent un cadre plus robuste de déploiement interne de l’IA |

| Contentful Personalization | Contenu et expérience numérique | Personnalisation de contenu avec documentation, intégration front-end et ressources de démarrage | Utile lorsque la personnalisation doit rester encadrée et cohérente avec une gouvernance de contenu |

| Wispr Flow | Productivité individuelle | Dictée vocale assistée par IA, disponible sur plusieurs plateformes | Intéressant pour accélérer la formulation des idées tout en gardant un contrôle humain sur le résultat |

Autres outils

- Claude Mythos — Modèle à accès restreint pour certains usages avancés en cybersécurité

- Perplexity Finance — Fonctions d’assistance financière alimentées par des données et interfaces dédiées à la finance

- Gemini — Interface multimodale de Google, avec approche explicite sur sécurité, contrôle utilisateur et confidentialité

- Snap Spectacles — Lunettes connectées et plateforme wearable, avec enjeux persistants de vie privée et de sécurité

- Adobe Project Indigo — Application caméra issue d’Adobe Labs, combinant photographie computationnelle, contrôles manuels et expérimentation IA

Message clé de la semaine

L’IA entre dans une phase où la vraie question n’est plus seulement ce qu’elle sait faire, mais au nom de qui elle agit, sous quelles limites, et avec quels recours pour les humains quand elle se trompe, surveille, remplace ou décide. Cette semaine, la technologie a avancé vite; la gouvernance, elle, a surtout révélé ses trous.

Conclusion stratégique

Les signaux des sept derniers jours convergent vers une même lecture : l’IA devient plus puissante, plus diffuse et plus structurante. Les modèles s’améliorent, les interfaces disparaissent, les agents passent de l’assistance à l’action, et les entreprises cherchent déjà à réorganiser certains usages autour de cette nouvelle donne.

La tension majeure est nette : la gouvernance demeure trop souvent réactive, privée ou implicite. Or une IA de sens suppose l’inverse — des règles visibles, des responsabilités nommées, des mécanismes de recours et une protection réelle des droits, du travail et de la vie privée.

Pour la suite, le bon réflexe n’est pas de ralentir l’IA par principe, ni de l’accélérer par réflexe. C’est de distinguer ce qui sert réellement l’humanité de ce qui sert surtout la concentration du pouvoir. C’est là, cette semaine encore, que se joue la différence entre une IA performante… et une IA de sens.

L’évolution s’accélère jour après jour avec l’IA et ses impacts. Pendant ce temps, la conscience humaine et l’ordre nécessaire pour y faire face s’érodent encore plus vite.

Savoir c’est pouvoir…. Pouvoir c’est aussi agir! Si tu as besoin de comprendre, n’hésite pas! Je peux approfondir des sujets qui te turlupine. Aussi, SVP partage. Il faut que la population développe son esprit critique afin de participer à la conversation publique.

La Brigade IA est en action. Je suis assignée sur le chamtier « Base culturelle et sécuritaire » dans un groupe très dynamique pour établir les guides de politique interne pour l’utilisation de l’IA. Si tu veux comprendre la Brigade IA en une image clique ici.. Les travaux ont débuté en grand et nous avançons bien. Une politique interne d’usage de l’IA est fondamental dans la volonté de faire de l’IA de sens.

Bonne journée!

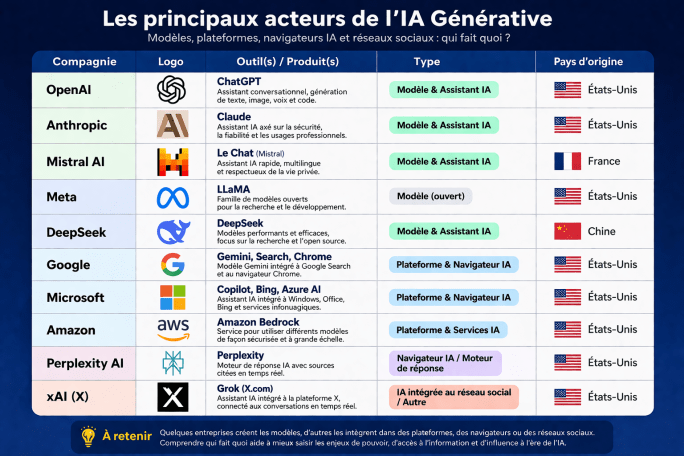

PERDU AVEC TOUS LES OUTILS D’IA GÉNÉRATIVE?

VOICI UN TABLEAU POUR COMPRENDRE LES DIFFÉRENTS ACTEURS

Si le sujet t’intéresse, voici des articles dans la catégorie « IA de sens ».

Au-delà des boosters et des doomers : vers une IA de sens

Un billet qui porte à réfléchir!

Boosters contre doomers. Optimisme contre inquiétude. L’IA divise plus que jamais. Entre promesses de progrès et craintes d’un futur déshumanisé, une question demeure : comment développer une véritable IA de sens?

L’IA n’est plus seulement une révolution technologique. Elle devient un choix de société.

La revanche des nerds ou la souveraineté cognitive?

Et si la vraie bataille de l’ère numérique ne se jouait pas sur les territoires… mais dans nos têtes?

À travers une réflexion personnelle et sans compromis, ce billet explore la montée en puissance des « nerds », devenus architectes d’un monde façonné par l’intelligence artificielle. Mais derrière cette revanche technologique se cache un enjeu…

La dette cognitive et la nouvelle économie du discernement

Ce qui m’interpelle dorénavant, ce sont les études qui se succèdent pour documenter les effets de l’utilisation de l’IAG dans le quotidien de la population. Je te préviens, ce n’est pas inquiétant, c’est alarmant. Nous parlons de « dette cognitive » rien de moins. L’humain a déjà assez de s’endetter financièrement, il s’endette dorénavant dans ses capacités…

Lire le monde tel qu’il est devenu

Nous vivons au cœur d’un système devenu trop vaste pour être saisi d’un seul regard : un hyperobjet technocapitaliste qui concentre pouvoir, richesse, données et énergie, tout en échappant au débat collectif. Pendant que l’attention se perd dans le vacarme émotionnel, les décisions qui engagent des générations se prennent presque en silence. Ce texte propose…

En savoir plus sur Sylvie Bédard - Complice de votre Présence

Abonnez-vous pour recevoir les derniers articles par e-mail.