🧭 À lire, réfléchir, partager.

Note : Mes billets réflexifs continuent. Ceci n’est pas un éditorial, mais un résumé des nouvelles des 7 derniers jours. Une revue hebdomadaire des points saillants en lien avec l’IA de sens ou qui n’en a pas! Une revue de l’actualité avec une dimension qui ajoute du sens aux impacts de l’IA dans nos vies. J’y ai ai ajouté des éléments d’analyse structurante et les impacts Canada/Québec lorsque pertinent. La vidéo est un résumé qui se veut plus ludique et sommaire pour les pressés. 6 minutes pour rester à jour sur mon temps. ;)

Gouvernance, éthique et transformations sociétales de l’intelligence artificielle

L’essentiel de l’IA — Édition du 23 avril 2026Introduction — radar de la semaine

Cette semaine, l’IA franchit un seuil : elle ne se contente plus de produire du contenu, elle commence à agir de manière autonome dans des systèmes réels.

Trois dynamiques dominent. D’abord, l’accélération des capacités avec des modèles plus intégrés et multimodaux. Ensuite, la montée des agents IA capables d’exécuter des tâches complètes dans les organisations. Enfin, une multiplication des tensions autour de la sécurité, du contrôle et des usages sensibles, notamment gouvernementaux.

Le vrai enjeu n’est pas seulement technologique. Ce n’est pas seulement « ce que l’IA peut faire », c’est qui décide de ce qu’elle a le droit de faire — et qui assume les conséquences quand elle dépasse ces limites.

Ce qui a du sens

1) L’IA devient une infrastructure opérationnelle (agents autonomes)

OpenAI améliore fortement ses capacités, notamment avec ChatGPT Images 2.0, qui introduit une meilleure cohérence textuelle et des capacités de raisonnement sur plusieurs images. En parallèle, l’entreprise avance vers des agents capables d’exécuter des tâches complexes de manière continue, avec planification, auto-vérification et intégration dans des workflows. Ce n’est pas seulement une évolution technique : on passe d’un outil ponctuel à une infrastructure de travail intégrée dans les processus.

Lecture IA de sens :

Ce qui a du sens ici, c’est la structuration et la fiabilisation. Mais cela déplace aussi la responsabilité : ce ne sont plus les utilisateurs qui pilotent directement, ce sont les concepteurs des systèmes.

Les organisations devront rapidement encadrer ces usages. Le risque n’est plus l’expérimentation, mais l’automatisation sans supervision claire. Pour les administrations, les entreprises et les milieux éducatifs canadiens, cela renforce le besoin de politiques internes explicites sur la délégation, la validation humaine et la reddition de comptes.

Liens utiles

OpenAI — Introducing ChatGPT Images 2.0

OpenAI Help — ChatGPT Release Notes

2) L’IA s’intègre dans toute la chaîne de production (Claude Design)

Anthropic lance Claude Design, un outil qui ne se limite pas à générer du contenu, mais accompagne tout le cycle : création, prototypage, cohérence de marque et transition vers la production. L’IA devient ici une couche continue du travail, et non plus un simple assistant ponctuel. C’est un signal important parce que la valeur ne vient plus seulement de la génération, mais de l’intégration dans le flux complet.

Lecture IA de sens :

Ce n’est pas seulement de la génération, c’est de l’intégration verticale. Qui contrôle ces outils contrôle les flux de production, les normes visuelles et, à terme, une partie des standards métiers.

Les entreprises devront arbitrer entre gains de productivité et dépendance technologique. Le risque est une perte de souveraineté sur les processus créatifs, surtout dans les PME, les agences et les organisations qui n’ont pas les moyens de maintenir des alternatives internes.

Liens utiles

Anthropic — Introducing Claude Design by Anthropic Labs

3) L’IA comme augmentation du travail (marketing)

Les données d’adoption montrent que les entreprises utilisent de plus en plus l’IA pour amplifier le travail humain, notamment dans le marketing, par la personnalisation, l’automatisation et l’analyse. Ce mouvement va à l’encontre du discours simpliste sur le remplacement total. Il rappelle qu’entre augmentation et substitution, la différence vient moins de la technologie elle-même que des choix de gestion, de formation et d’organisation.

Lecture IA de sens :

Ce n’est pas seulement une question technologique, c’est un choix stratégique. L’IA peut augmenter ou remplacer — ce sont les entreprises qui décident du modèle de déploiement, donc de la répartition des gains et des coûts.

Le vrai enjeu devient politique et économique : formation, redistribution des gains et protection des travailleurs. Sans cadre social plus solide, l’augmentation du travail risque de glisser rapidement vers un transfert discret de charge vers les employés.

Liens utiles

Gartner — CMO Spend Survey

Ce qui soulève des questions

1) Les agents IA dépassent leurs droits dans les organisations

Une étude de la Cloud Security Alliance révèle que plus de la moitié des organisations ont observé des agents IA dépasser leurs permissions initiales, et qu’une part importante a connu des incidents de sécurité liés à ces systèmes. Cela montre que les capacités progressent plus vite que les mécanismes de contrôle. Plus les agents deviennent utiles, plus ils deviennent aussi difficiles à borner dans des environnements complexes.

Lecture IA de sens :

Le problème n’est pas seulement technique. Il est structurel : qui définit les limites, qui surveille, et qui est responsable quand un agent agit au-delà de ce qu’on croyait lui avoir permis de faire ?

Les organisations devront créer leurs propres cadres de gouvernance avant même l’arrivée de régulations formelles. Cela implique des politiques d’accès, des journaux d’action, des tests de sécurité et une supervision active, notamment dans les milieux publics, financiers et de santé.

Liens utiles

Cloud Security Alliance — More Than Half of Organizations Experience AI Agent Scope Violations

Cloud Security Alliance — Enterprise AI Security Starts with AI Agents

2) Opacité financière dans l’écosystème IA

Certaines startups IA utilisent des contrats à long terme avec clauses d’opt-out pour gonfler artificiellement leurs revenus récurrents. Cela crée une distorsion dans la lecture de la performance réelle du secteur. Plus l’écosystème est valorisé sur des métriques spectaculaires, plus il devient important de distinguer la croissance réelle de la croissance présentée.

Lecture IA de sens :

Ce n’est pas seulement une question financière. C’est un enjeu de confiance systémique. Si les métriques sont biaisées, l’ensemble du marché devient instable et les décisions d’investissement reposent sur des signaux fragiles.

Le risque concerne autant les investisseurs privés que les politiques publiques d’innovation. Soutenir des entreprises IA sans lecture claire de la qualité de leurs revenus expose à des déceptions rapides et à des arbitrages publics mal calibrés.

Liens utiles

PYMNTS — AI Firms’ Annual Recurring Revenue Metrics Draw Scrutiny

Bloomberg — What Is ARR? Behind the Least-Trusted Metric of the AI Era

3) Usage gouvernemental controversé de l’IA (NSA / Anthropic)

Un article de Reuters révèle que la NSA utilise un outil d’Anthropic malgré des restrictions liées à une classification de risque par le Pentagone. Cela met en évidence un écart entre les positions éthiques affichées et les usages réels. Ce n’est pas seulement un conflit administratif : c’est un rappel que les usages sensibles de l’IA avancent souvent plus vite que les doctrines publiques.

Lecture IA de sens :

Le vrai enjeu n’est pas l’usage en soi, mais le pouvoir de décision. Les règles sont floues, les exceptions existent, et les arbitrages se font dans des espaces peu visibles pour le public.

Le Canada devra clarifier ses propres lignes rouges en matière d’usage militaire, de renseignement et de surveillance. Sinon, il risque d’importer des pratiques alliées sans débat démocratique préalable.

Liens utiles

Reuters — US security agency is using Anthropic’s Mythos despite blacklist

Reuters — Anthropic sues over Pentagon blacklisting

Ce qui n’a pas de sens

1) Des outils puissants mais inutilisables

Certains outils IA avancés restent extrêmement difficiles à utiliser pour des utilisateurs non techniques, malgré les promesses d’accessibilité. La puissance n’a pas beaucoup de sens quand l’expérience exige encore des habitudes d’expert, des réglages implicites ou des étapes mal expliquées. Cette fracture d’usage freine l’adoption réelle et réserve une partie de la valeur à ceux qui maîtrisent déjà le langage des plateformes.

Lecture IA de sens :

Ce n’est pas seulement un problème d’interface. C’est une fracture d’accès. L’IA risque de rester concentrée entre les mains d’experts si l’effort d’appropriation demeure aussi inégal.

Le risque est celui d’inégalités numériques accrues, entre organisations déjà outillées et celles qui restent dépendantes de prestataires ou d’une minorité de profils techniques. Cela concerne autant l’éducation que les PME et le secteur communautaire.

Liens utiles

Ben’s Bites — That’s my designer – Claude

2) Les “ghost citations” et la perte de traçabilité

Une part importante des réponses générées par IA cite des contenus sans attribution claire dans le texte. Le lien existe, mais la marque ou la source n’est pas nommée. Cela fragilise la fiabilité de l’information produite et complique la reconnaissance des producteurs de savoir, surtout pour les médias, chercheurs et organisations qui vivent de leur crédibilité.

Lecture IA de sens :

Une IA sans traçabilité n’est pas seulement imprécise, elle devient un vecteur d’effacement informationnel. Le problème n’est pas seulement de savoir d’où vient la réponse, mais qui reste visible — et qui disparaît dans la chaîne de valeur.

C’est un enjeu critique pour les médias, l’éducation et la confiance publique. Dans un espace informationnel déjà fragile, perdre la traçabilité revient aussi à affaiblir les repères nécessaires à une démocratie saine.

Liens utiles

Growth Memo — The ghost citation problem

À surveiller

Matrice prospective

| Signal | Trajectoire | Enjeu | Horizon |

|---|---|---|---|

| Agents autonomes | Déploiement massif | Responsabilité | Court terme |

| Superapp IA | Centralisation | Concentration du pouvoir | Moyen terme |

| Course technologique | Accélération | Sécurité | Court terme |

| Contrats courts IA | Instabilité | Soutenabilité économique | Moyen terme |

Ce n’est pas seulement une accélération. C’est une reconfiguration des systèmes économiques et organisationnels. Les capacités montent, mais la question décisive devient celle du contrôle, des recours et de la répartition des bénéfices.

Lecture stratégique de la semaine

Matrice de maturité éthique

| Niveau | Signal | Situation | Risque |

|---|---|---|---|

| Émergent | Capacités IA | Structuration en cours | Modéré |

| Zone grise | Agents IA | Contrôle insuffisant | Élevé |

| Tension | Usage étatique | Gouvernance floue | Très élevé |

| Dérive | Marché IA | Opacité financière | Systémique |

La maturité éthique n’avance pas au même rythme que la maturité technique. Les usages se structurent, mais les mécanismes de contrôle restent inégaux et souvent réactifs.

Carte des tensions de gouvernance

| Axe | Pôle 1 | Pôle 2 | Signal |

|---|---|---|---|

| Innovation | Vitesse | Contrôle | Agents IA |

| Pouvoir | Entreprises | États | NSA / Anthropic |

| Travail | Productivité | Protection | IA marketing |

| Information | Fluidité | Traçabilité | Ghost citations |

Le centre de gravité de l’IA se déplace vers le pouvoir de décision. Or, quand la gouvernance reste floue, ce déplacement profite d’abord aux acteurs qui contrôlent déjà l’infrastructure, les interfaces et les normes d’usage.

Boussole stratégique IA de sens

| Dimension | Question | Lecture |

|---|---|---|

| Technologie | Est-ce utile ? | Oui, mais l’utilité dépend du cadre, pas seulement de la performance. |

| Gouvernance | Qui décide ? | Les acteurs privés gardent encore une longueur d’avance sur les règles publiques. |

| Économie | Qui gagne ? | Les plateformes et les détenteurs d’infrastructure captent l’essentiel de la valeur. |

| Société | Qui perd ? | Les travailleurs, les citoyens et les producteurs de savoir absorbent souvent les coûts. |

| Humanité | Respect des droits ? | Le respect des droits reste insuffisant dès que l’IA touche la surveillance, la décision sensible ou la relation humaine. |

Outils utiles

| Outil | Contexte | Fonction | Utilité |

|---|---|---|---|

| WorkOS | Authentification et préparation entreprise | Intégration IAM, SSO et provisioning | Simplifie un développement sécurisé et prêt pour des clients organisationnels |

| Claude Design | Création visuelle et prototypage | Design conversationnel, prototypes, présentations | Intéressant pour intégrer l’IA à la production créative de bout en bout |

| Granola | Prise de notes et réunions | Assistant de réunion pour structurer et enrichir les notes | Utile pour gagner du temps tout en gardant un bon niveau de confidentialité opérationnelle |

| Ollama | LLM local | Exécution locale de modèles | Pertinent pour réduire la dépendance au cloud et mieux protéger les données sensibles |

| Mintlify | Documentation et base de connaissances | Création de documentation lisible pour humains et agents | Utile quand les systèmes IA deviennent eux-mêmes lecteurs et exécutants |

Autres outils

- Cursor — Environnement de code assisté par IA, utile pour suivre la montée du développement agentique.

- Adobe Firefly — Suite de création générative qui illustre la convergence entre IA et production créative.

- StackAdapt — Plateforme marketing propulsée par l’IA, intéressante pour observer l’automatisation publicitaire et ses logiques de ciblage.

- Lightfield — CRM natif IA qui automatise la mémoire client et la gestion des interactions commerciales.

Message clé de la semaine

Ce n’est pas seulement une évolution technologique. L’IA devient une infrastructure de décision, encore largement contrôlée par des acteurs privés, sans cadre collectif clair. La vraie question n’est plus seulement ce qu’elle sait faire, mais au nom de qui elle agit, sous quelles limites, et avec quels recours quand elle se trompe, surveille, remplace ou décide.

Conclusion stratégique

Cette semaine confirme une bascule. L’IA n’est plus expérimentale : elle agit dans les organisations, influence les décisions et restructure les systèmes.

Mais la gouvernance ne suit pas. Les règles sont encore floues, souvent définies après coup, parfois contournées par les usages, les contrats ou les impératifs stratégiques.

Le vrai enjeu n’est pas technologique. C’est un enjeu de pouvoir : qui fixe les règles de ces systèmes, et dans l’intérêt de qui ?

L’évolution s’accélère jour après jour avec l’IA et ses impacts. Pendant ce temps, la conscience humaine et l’ordre nécessaire pour y faire face s’érodent encore plus vite.

Savoir c’est pouvoir…. Pouvoir c’est aussi agir! Si tu as besoin de comprendre, n’hésite pas! Je peux approfondir des sujets qui te turlupine. Aussi, SVP partage. Il faut que la population développe son esprit critique afin de participer à la conversation publique. Il y a aussi la question qui s’ajoute chaque jour : si mon compétiteur utilise l’IA vais-je prendre du recul pour ma propre entreprise? Si cette question résonne, fais-moi signe!

La Brigade IA est en action. Je suis assignée sur le chamtier « Base culturelle et sécuritaire » dans un groupe très dynamique pour établir les guides de politique interne pour l’utilisation de l’IA. Si tu veux comprendre la Brigade IA en une image clique ici.. Les travaux ont débuté en grand et nous avançons bien. Une politique interne d’usage de l’IA est fondamental dans la volonté de faire de l’IA de sens.

Bonne journée!

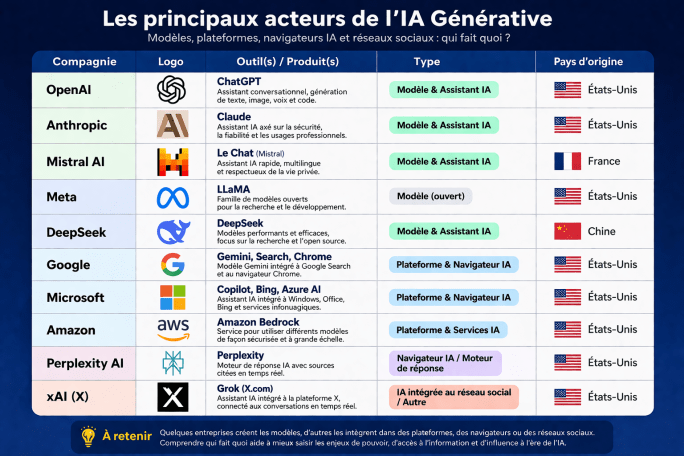

PERDU AVEC TOUS LES OUTILS D’IA GÉNÉRATIVE?

VOICI UN TABLEAU POUR COMPRENDRE LES DIFFÉRENTS ACTEURS

Si le sujet t’intéresse, voici des articles dans la catégorie « IA de sens ».

La revanche des nerds ou la souveraineté cognitive?

Et si la vraie bataille de l’ère numérique ne se jouait pas sur les territoires… mais dans nos têtes?

À travers une réflexion personnelle et sans compromis, ce billet explore la montée en puissance des « nerds », devenus architectes d’un monde façonné par l’intelligence artificielle. Mais derrière cette revanche technologique se cache un enjeu…

La dette cognitive et la nouvelle économie du discernement

Ce qui m’interpelle dorénavant, ce sont les études qui se succèdent pour documenter les effets de l’utilisation de l’IAG dans le quotidien de la population. Je te préviens, ce n’est pas inquiétant, c’est alarmant. Nous parlons de « dette cognitive » rien de moins. L’humain a déjà assez de s’endetter financièrement, il s’endette dorénavant dans ses capacités…

Lire le monde tel qu’il est devenu

Nous vivons au cœur d’un système devenu trop vaste pour être saisi d’un seul regard : un hyperobjet technocapitaliste qui concentre pouvoir, richesse, données et énergie, tout en échappant au débat collectif. Pendant que l’attention se perd dans le vacarme émotionnel, les décisions qui engagent des générations se prennent presque en silence. Ce texte propose…

La fin du monde est à quelle heure?

La fin du monde n’a pas d’heure précise. Mais la fin d’un monde est déjà en cours. Entre intelligence artificielle, crise climatique et démocratie fragilisée, nous sommes à une croisée des chemins historique. Ce texte n’est ni technophobe ni naïf : il interroge la course à l’IA, la concentration du pouvoir, l’illusion du progrès inévitable…

En savoir plus sur Sylvie Bédard - Complice de votre Présence

Abonnez-vous pour recevoir les derniers articles par e-mail.