Quand la tondeuse IA coupe plus vite que prévu

Couper son gazon avec des ciseaux est tout à fait possible, mais une fois que l’on a expérimenté la tondeuse, l’idée de revenir aux ciseaux paraît absurde. L’intelligence artificielle génère précisément ce type de rupture technologique. Elle accélère les tâches, simplifie ce qui semblait compliqué, et change notre rapport au temps et à la productivité.

Je confirme pour la tester chaque jour depuis plus de trois ans, l’IA est hautement addictive. Elle nous procure un sentiment de puissance, nous faisant sentir plus rapides, plus autonomes, voire plus « intelligents ». Ce sentiment est fondé sur un gain de productivité bien réel. Elle me surprend constamment et s’améliore sur bien des aspects depuis ses débuts.

Fallait voir une amie dernièrement parler avec ChatGPT en mode vocal et lui demander de parler avec un accent québécois. Dès qu’une question émerge dans sa tête, elle active son assistante IA et ne fait que parler sans même texter. Aucun besoin de savoir écrire, simplement parler. Donc, terminé les recherches sur Google ou autres, les claviers. Vive le chemin le plus court. Elle ne reviendra pas à la recherche où elle doit réfléchir à sa question et la taper. Et ils sont dorénavant 800 millions chaque semaine à utiliser les intelligences artificielles génératives ou les robots conversationnels.

Les chiffres démontrent cette bascule irréversible :

- L’assistant IA de Klarna gère désormais l’équivalent du travail de 700 agents humains au service client, réduisant le temps de réponse moyen par client de 11 minutes à moins de 2 minutes.

- Duolingo, en déplaçant une partie du travail vers l’IA de génération de contenus, a réduit ses effectifs de contractants d’environ 10 % au début de 2024.

À petite échelle, l’utilisateur d’outils comme ChatGPT gagne l’équivalent d’une heure de travail en seulement dix minutes. Une fois que l’on a connu la tondeuse, revenir aux ciseaux devient impensable. Cette orientation est claire : là où l’IA s’intègre bien, la productivité bondit, et l’ancienne façon de faire devient vite « impensable ». Pourrions-nous imaginer revenir aux téléphones à roulette?

L’effet pervers : le risque d’une manipulation de la vérité

L’euphorie productive s’accompagne souvent d’une tendance à surestimer les effets positifs. Cependant, l’intégration rapide de l’IA générative introduit un risque majeur : la propagation de fausses informations. Le taux de fausses informations relayées par les chabots a presque doublé en un an, selon une récente étude de NewsGuard. La faute à leur difficulté à identifier les sources crédibles dans l’écosystème informationnel. Ils remâchent aussi bien les données polluées que les données saines. Exactement comme l’image que j’ai mise dans mon livre au sujet de cette tendance à terme à produire que du contenu que les IA auront fait.

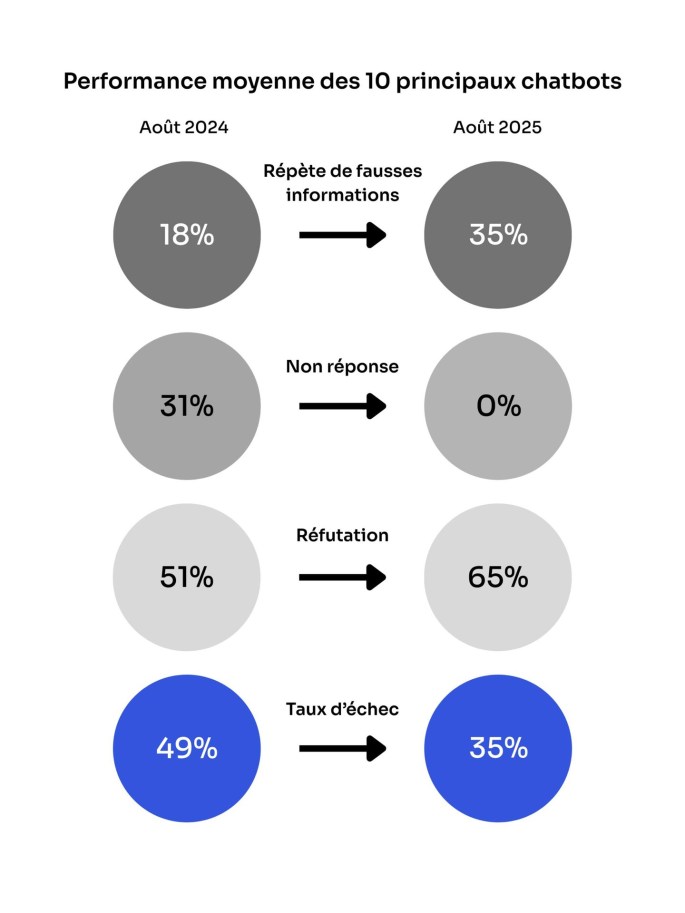

Les données récentes montrent que les outils d’IA sont loin d’être des garants de la vérité:

- La performance moyenne des 10 robots conversationnels les plus populaires en termes de répétition de fausses informations est passée de 18 % en août 2024 à 35 % en août 2025.

- Parallèlement, le pourcentage de non-réponse de ces robots est tombé de 31 % à 0 %. Cela signifie que l’IA répond de plus en plus, mais qu’elle est de plus en plus susceptible de véhiculer des inexactitudes.

- Pour certains modèles spécifiques en août 2025, le pourcentage de réponses contenant de fausses informations était alarmant, comme Inflection à 56,67 % et Perplexity à 46,67 %. D’autres, comme ChatGPT, Claude, et Copilot, affichaient 40 %. (J’ai eu un choc des résultats de Perplexity que j’aimais bien qui est passé de 0% à 46.67% ☹… mais Claude… 10%!!! Impressionnant).

Si l’IA devient indispensable pour sa rapidité, nous ne pouvons pas ignorer la conséquence d’une dépendance à des outils dont la fiabilité est si faible pour la vérité. Je nuance tout de même en précisant que les tâches automatisées de l’IA ne sont pas nécessairement reliées à une recherche de vérité, mais bien à des traitements de données de sources internes très souvent.

L’illusion du visible : quand « voir » ne veut plus dire « croire »

L’euphorie productive, si elle est séduisante, nous pousse à sous-estimer les effets pervers, notamment sur notre perception de la réalité. L’IA générative est devenue si performante que l’adage populaire « Je vais le croire quand je vais le voir! » est désormais obsolète.

L’industrie du cinéma nous fournit un exemple frappant de cette bascule. Récemment, l’actrice virtuelle Tilly Norwood, créée de toutes pièces par l’intelligence artificielle, a été présentée au Festival du film de Zurich. Les extraits vidéo dans lesquels elle apparaît sont hyperréalistes. La nouvelle série québécoise « Indétectable » est basée sur ces hyper trucages.

Même des logiciels d’IA gratuits sont « bluffants de réalisme ». L’actrice Emily Blunt a exprimé son inquiétude, jugeant la création d’avatars IA « vraiment, vraiment terrifiant » et appelant les agents à cesser de « nous priver de nos liens humains ».

L’économie du remplacement et la manipulation

L’impératif derrière la création de ces avatars n’est pas technologique, il est économique. Il est beaucoup moins coûteux de créer une « actrice » virtuelle que de payer une vedette comme Scarlett Johansson 20 millions de dollars par rôle. La conceptrice de Tilly Norwood, Eline Van der Velden, a d’ailleurs déclaré que l’objectif était de faire de Tilly la prochaine Scarlett Johansson ou Natalie Portman, permettant à la créativité de ne pas être « bridée par un budget ».

Le syndicat américain des acteurs (SAG-AFTRA) s’est insurgé, précisant que « Tilly Norwood » n’est pas une actrice, mais un personnage généré par un programme informatique entraîné grâce au travail d’innombrables acteurs professionnels, souvent sans autorisation ni rémunération.

Pourtant, la dépendance est déjà là. La créatrice de Tilly Norwood estime que le public s’intéresse d’abord à l’histoire, et non au fait de savoir si la vedette est vivante ou un avatar, surtout si la différence est invisible à l’œil nu. Qui a tort ou raison?

Ce que cet exemple nous apprend sur la vérité est double :

- Fiabilité visuelle en chute : Nos yeux ne sont plus des garde-fous fiables pour juger de l’authenticité d’une image ou d’une vidéo.

- Fiabilité statistique en chute : Parallèlement, les robots conversationnels d’IA sont de plus en plus susceptibles de propager de fausses informations. Si la performance moyenne des 10 robots conversationnels les plus populaires est passée de 18 % à 35 % de fausses informations entre août 2024 et août 2025 qu’en sera-t-il entre août 2025 et août 2026?

Face à l’appétit du profit qui semble plus grand que le désir de préserver l’humanité, il est urgent que les gouvernements interviennent rapidement. La question n’est pas seulement éthique, elle est économique : le capitalisme crée un « effet secondaire malencontreux » où l’on ne peut compter sur les entreprises pour réguler l’IA ou contrer ses effets négatifs. Et franchement, il faut vivre dans une grotte pour croire que les entreprises seront ces garde-fous, elles baisent toutes la bague du nouveau « King orange ».

Les conséquences sociales et environnementales urgentes

L’adoption généralisée et rapide de l’IA s’accompagne d’une anxiété sociale. L’automatisation fait craindre le sort du travail quand les outils deviennent beaucoup plus capables. L’ancienne promesse d’une « société de loisirs » pour l’an 2000 risque de se réaliser sous la forme de loisirs sans revenus, ce qui engendre l’ennui et l’angoisse. La perte de sens et d’utilité sont déjà les causes de la dépression des personnes âgées, imaginons ce phénomène à 35 ou 45 ans.

Qu’en est-il des pertes d’emploi : exagération médiatique ou choc réel ?

Les signaux sont mixtes — et il faut l’assumer.

- Côté macro : le FMI estime que 40 % de l’emploi mondial est exposé à l’IA (et ~60 % dans les économies avancées). Une moitié des emplois exposés pourrait bénéficier d’un complément IA ; pour l’autre moitié, l’IA risque de réduire la demande de travail, voire supprimer certains postes. (elibrary.imf.org)

- Côté micro / annonces : les rapports mensuels de Challenger, Gray & Christmas montrent que certaines vagues de licenciements mentionnent explicitement l’IA comme motif. Juillet 2025 marque un pic : plus de 10 000 suppressions citées « à cause de l’IA » dans le mois. (challengergray.com)

- Mais attention au biais de narration : selon Challenger, les licenciements “dus à l’IA” restent sous-déclarés et comptent peu parmi les motifs officiels en 1er semestre 2025 (seulement 75 coupes explicitement attribuées à l’IA dans les communiqués), ce qui suggère tantôt une minoration (les entreprises n’osent pas le dire), tantôt une surinterprétation médiatique. Des chercheurs (Yale, Brookings) notent aussi qu’à ce stade, l’IA n’explique pas la majorité du ralentissement du marché du travail américain : d’autres facteurs pèsent plus lourd. (cfodive.com). Pour le marché canadien, aucune donnée disponible selon mes recherches. C’est tout dire.

- Phénomène déjà anticipé et que je mentionne dans mon livre dont l’une des solutions va être de créer des fonds de compensation pour aider les employés remplacés par l’IA à se retrouver un emploi. La société ne pourra pas assumer tous ces chômeurs tandis que tous les gains de productivité seront au seul profit des entreprises. Et déjà ajouter une case au formulaire de demande d’assurance-emploi : remplacé par l’IA et une obligation de déclarer les abolitions de postes à cause de l’IA.

En clair : oui, il y a un effet IA, non, ce n’est pas (encore) un “grand remplacement” à grande échelle. Mais l’orientation est claire : là où l’IA s’intègre bien, la productivité bondit, et la structure des tâches se recompose… Même les miennes et cela quotidiennement depuis plus de deux ans.

Les enjeux sociaux : le jardinier et les 60 %

Le véritable enjeu est la recomposition du travail. Si l’IA coupe vite, la question est de savoir qui tiendra le manche de la tondeuse ou la manette de contrôle et que devient le jardinier quand son outil le remplace? Il existe un risque plausible que les diplômés universitaires se transfèrent vers des emplois moins éduqués, laissant les travailleurs moins éduqués assumer le plus gros du fardeau du remplacement.

Il faut également noter la concentration du pouvoir : les géants de la technologie détiennent une capitalisation boursière « phénoménalement énorme ». Cette concentration pourrait mener à ce que les profits de l’IA se concentrent dans seulement deux pays, les États-Unis et la Chine, une dynamique qui pourrait être « catastrophique » pour des économies comme le Canada.

Les enjeux environnementaux et énergétiques

Au-delà des défis sociaux et de souveraineté, l’IA et le numérique posent d’importants défis environnementaux.

- Consommation de ressources : L’entraînement d’un modèle d’IA consomme des ressources colossales, et chaque site web a une empreinte carbone réelle.*

- Demande énergétique : Il y a une croissance « exponentielle » de la demande en énergie des centres de données. Cette expansion « ne peut pas continuer éternellement » et risque de ne plus laisser assez d’électricité pour tout le monde.

- Combustibles fossiles : La demande pour les combustibles fossiles augmente à cause de l’IA, et les géants du secteur investissent dans des pays producteurs de pétrole.

La hausse du coût de l’énergie qui en résulte risque d’alourdir la facture des citoyens, sans que ceux-ci ne bénéficient nécessairement des profits des entreprises d’intelligence artificielle.

Redéfinir son terrain : l’urgence de l’IA de sens

Puisque revenir aux ciseaux n’est ni réaliste ni souhaitable, la question pertinente est : comment allons-nous adopter l’IA et qui tient le manche de la tondeuse? C’est l’urgence d’une « IA de sens » qui doit nous guider.

Au début du Web, j’ai écrit un livre sur l’urgence de la Présence pour se rapprocher de nos clients et employés grâce aux outils de communication numérique. J’ai converti mon entreprise pour faire du marketing de sens. J’y croyais profondément, même si la transition a pris du temps. J’ai formé des centaines de personnes, j’ai fait des conférences pour convaincre des bienfaits d’embrasser la nouvelle réalité virtuelle. Avec l’IA, nous sommes littéralement face à un dilemme cornélien. L’utiliser ou être obsolète! Depuis octobre 2022, je ne cesse de me poser la question et surtout de chercher des réponses.

Au Canada, nous avons une recherche de classe mondiale (Mila, Vector Institute). Cependant, nos infrastructures critiques sont fortement dépendantes d’acteurs étrangers :

- Les modèles d’IA appartiennent à des entités non canadiennes (OpenAI, Anthropic, Google DeepMind, Meta).

- Le cloud est dominé par AWS, Microsoft Azure et Google Cloud.

- Les puces proviennent de Nvidia et TSMC.

Si nous adoptons tous la « tondeuse » IA, mais qu’elle appartient aux voisins, nous n’avons plus de contrôle sur notre propre jardin.

C’est comme si nous avions une magnifique équipe de hockey, mais que la patinoire, les rondelles et les bâtons appartenaient à des pays voisins. Comment marquer des buts si tout l’équipement et les infrastructures ne sont pas à nous ?

Si nous voulons que la société de demain ne soit pas une simple dépendance, il est urgent de penser infrastructures souveraines : chaînes de valeur locales, centres de données locaux, énergie verte, capacité de former nos propres modèles, gouvernance sur nos données. Il me semble que si les pipelines pour le pétrole occupent les priorités du gouvernement, la même urgence devrait les animer en ce qui concerne notre souveraineté numérique.

Je parle de souveraineté numérique depuis un bon moment, et mon livre sorti en 2023, trouve écho de plus en plus avec les nombreuses conférences à ce sujet.

J’ai assisté au Colloque sur la souveraineté numérique organisé par Micrologic à Québec le 10 septembre dernier. Ils ont bien résumé les enjeux de la souveraineté numérique. Leur « cloud souverain » est une lueur d’espoir en ce sens. Cette conférence est assez percutante, je recommande.

Comme je parle du Canada et ses citoyens en tant que colonisés numériques… nous pourrions donc voir Micrologic comme des « patriotes numériques » qui offrent une alternative à l’emprise étrangère. Il est plus que temps que les empereurs numériques ne soient plus, ou le moins possible, dans l’équation numérique. Alain Saulnier les appelle les « Barbares numériques ». Appellation différente, même combat. Bref! Un éveil se fait sentir et c’est un bon début.

Attention, je ne parle pas des « luddites » imaginés par les auteurs de la série de science-fiction « Upload » et inspiré des ouvriers anglais du XIXe siècle qui cassaient les machines à tisser, parce qu’ils y voyaient une menace pour leur travail et leur dignité.

Bien que je pense qu’ils sont de retour de différentes manières comme les mouvements de résistance au numérique qui s’expriment par la sobriété numérique, les collectifs de “digital detox”, appels à la régulation de l’IA, etc.

Je ne suis pas une « luddite », je prônerais plus un mouvement de conscience numérique, car je crois qu’on peut réellement faire de l’IA de sens si nous comprenons bien les limites et les enjeux. Non, ce n’est pas une utopie sauf si nous choisissons de ne rien faire individuellement et collectivement pour que les priorités du gouvernement soient bien claires. L’environnement et l’IA sont deux dossiers qui vont de pair à bien des égards.

Un appel à l’action pour les entreprises

L’IA peut transformer une PME québécoise ou canadienne, mais elle peut aussi l’écraser si elle n’est pas préparée. Il est essentiel de s’assurer que l’on passe de l’utilisateur à celui qui supervise ou gère son propre terrain. C’est malheureux, mais le progrès avance avec ou malgré nous.

Suis-je encore en train de couper mon gazon avec des ciseaux ?

Pour s’assurer de garder la main sur l’outil et intégrer l’IA avec vision, chaque dirigeant doit procéder à une autoévaluation en cinq axes :

- Automatisation -> Quelles tâches répétitives peuvent être déléguées à une IA sans perdre en qualité / contrôle? Ici, c’est comprendre les différents niveaux d’usages : aide à la décision, automatisation de tâches, ou délégation à un agent IA autonome.

- Données -> Où résident les données critiques (serveurs locaux, cloud canadien, ou serveurs étrangers)? Questions fondamentales avec la loi 25, je peux vous aider à ce sujet.

- Compétences -> Les équipes sont-elles formées à travailler efficacement avec les outils IA? Y ont-elles accès et utilisent-elles les bons outils?

- Valeur client -> Quels services peuvent être augmentés par l’IA sans déshumaniser la relation? Personne ne veut consciemment une IA comme interlocuteur, mais entre avoir personne et une IA, quelle la meilleure option?

- Souveraineté -> Quel pourcentage des outils stratégiques est sous contrôle canadien ou interne?

Ces questions permettent de voir comment passer des ciseaux à la tondeuse ou au robot-tondeur et où il faut maintenir un contrôle humain.

Conclusion : garder la main sur la tondeuse

Nous ne reviendrons pas aux ciseaux. L’IA est une tondeuse : elle est puissante, mais elle exige de nouvelles règles d’usage. Elle peut même être autonome et faire le travail pendant notre sommeil.

L’enjeu n’est pas de refuser l’outil, mais de l’adopter avec lucidité. Cela nécessite :

- Des infrastructures souveraines pour protéger nos données et nos choix.

- Des entreprises lucides qui se préparent activement à l’intégrer en transformant les postes et les tâches plutôt qu’en licenciant.

- Une société qui organise la redistribution de la valeur et la montée en compétences pour ne pas confondre loisirs et exclusion.

Chaque jour nous construisons le futur dans lequel nous allons vivre et les générations à venir. Rappelons-nous que le Québec et le Canada ont lamentablement échoué à faire la transition numérique lorsqu’il aurait été temps de faire des choix pour ne pas devenir des colonisés numériques. Allons-nous répéter les mêmes erreurs? C’est maintenant qu’il faut agir, car l’IA va plus vite que la courbe d’adoption du Web il y a 25 ans. J’écoutais « Avant le crash » hier, et le « pitch de vente » au 1er ministre sur la souveraineté numérique m’a fait sourire. Les auteurs de télésérie sont plus avant-gardistes que nos gouvernements!

Si tu es une petite entreprise, sache que l’automatisation de base de bien des petites tâches est déjà une bonne idée à envisager. Je suis présentement à faire des projets de ce type pour tester le plein potentiel de l’IA. Tout commence par de petites automatisations et éventuellement ces gains de temps permettent de s’investir enfin sur des projets qui nous tiennent à cœur.

Si l’IA de sens t’intéresse, parlons-en! Écris-moi!

Peut-être aimerais-tu faire cette auto-évaluation sans prétention pour connaître ton niveau de maturité numérique dans ton entreprise?

*Note environnementale 🌱

Au-delà des enjeux sociaux et de souveraineté, l’IA et le numérique posent aussi des défis environnementaux. L’entraînement d’un modèle consomme des ressources colossales, et chaque site web a une empreinte carbone réelle. Le Collectif du numérique responsable a récemment publié une cartographie permettant aux entreprises d’identifier des organismes capables de les aider à réduire cette empreinte. Ce n’est pas le cœur de ce billet, mais il serait irresponsable de l’ignorer.

Voici la liste des sources utilisées :

- « Actrice virtuelle créée par l’IA | Une Scarlett Johansson à bas prix | La Presse » (Ce document fournit l’exemple de Tilly Norwood, l’actrice virtuelle, et les préoccupations du syndicat SAG-AFTRA, ainsi que les citations d’Emily Blunt et l’enjeu économique du remplacement des acteurs.)

- « Intelligence artificielle | Entre occasion et désastre, préviennent des experts | La Presse » (Ce document présente les avertissements d’experts comme Yoshua Bengio et Daron Acemoglu concernant la concentration du pouvoir dans deux pays [États-Unis et Chine], les défis liés à la formation de la relève, et les conséquences environnementales et sociales de la croissance exponentielle de la demande en énergie des centres de données.)

- NewsGuard (statistiques sur les robots conversationnels https://www.newsguardtech.com/fr/special-reports/audit-chatbots-fausses-affirmations-double/ )

En savoir plus sur Sylvie Bédard - Complice de votre Présence

Abonnez-vous pour recevoir les derniers articles par e-mail.

Un commentaire sur « Couper son gazon avec des ciseaux en 2025 ou pourquoi l’IA crée une dépendance irrévocable ? »